TurboQuant Google contro il mercato della memoria: chi vince davvero

Sei volte meno memoria. Zero perdita di accuratezza. Un algoritmo gratis che fa tremare un’industria da duecento miliardi di dollari. Questo è il pitch di TurboQuant, la compressione Google per la KV cache degli LLM a 3 bit — e se vi sembra troppo bello per essere vero, probabilmente avete ragione. Almeno in parte.

Il 25 marzo 2026, Google Research ha ripresentato al mondo un paper accettato a ICLR 2026 che giaceva su arXiv da aprile 2025. Undici mesi. La ricerca più potenzialmente disruptive per i produttori di chip di memoria era lì, in bella vista, e nessuno aveva battuto ciglio. Poi è arrivato un blog post con grafici colorati, e SK Hynix ha perso il 6,23% in una seduta. Samsung -4,71%. Micron -3,40%. Il KOSPI giù del 3%.

Un blog post.

Ma il numero che conta — quello che i titoli sensazionalistici hanno sepolto — è un altro: la riduzione reale di memoria non è 6x. È circa 2,6x. Perché il 70-80% dell’inference in produzione già usa FP8, non i 16 bit del paper. Il confronto onesto parte da 8 bit, non da 16. E da 8 a 3 bit, i conti cambiano parecchio. Chi ha seguito la crisi dei prezzi GPU spinta dall’AI sa che i numeri di marketing e quelli reali raramente coincidono.

Come funziona TurboQuant (senza il marketing)

L’idea di fondo è elegante. TurboQuant combina due tecniche: PolarQuant (AISTATS 2026), che converte i vettori della KV cache in coordinate polari prima della quantizzazione, e QJL (AAAI 2025), che riduce l’errore residuo a un singolo sign bit con zero overhead di memoria. Il risultato: 3 bit per canale, giù dai 16 standard.

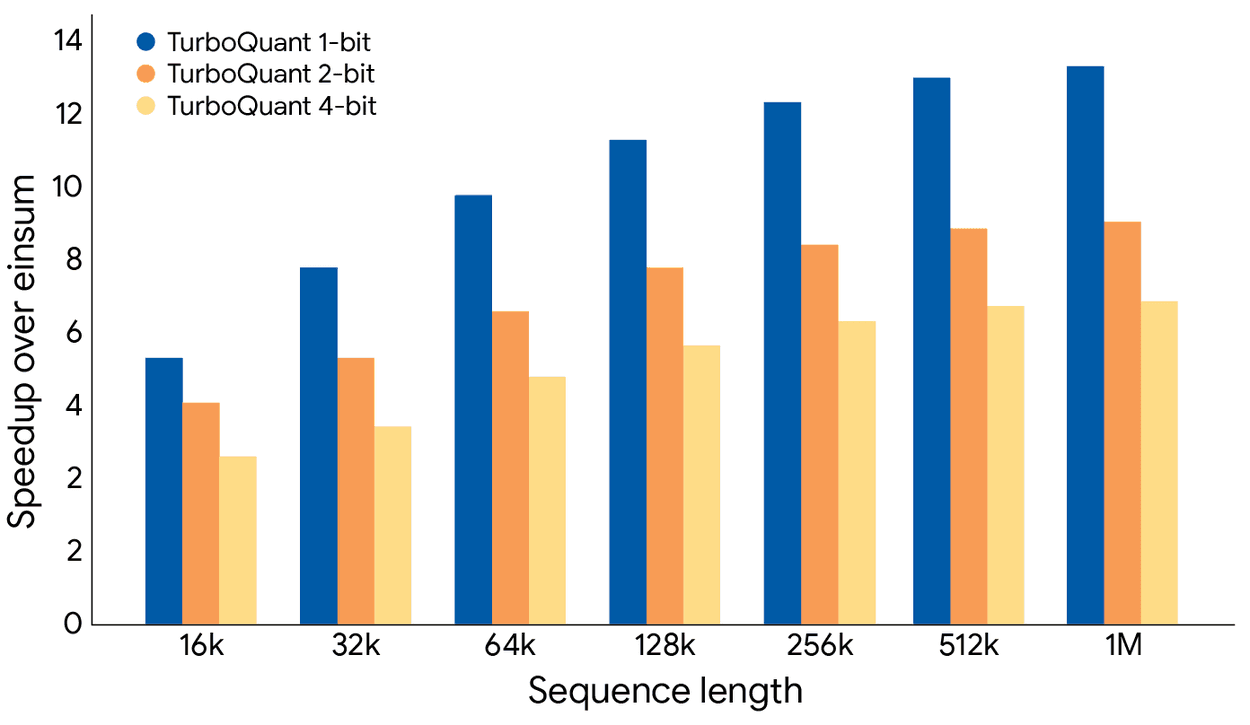

La parte interessante è che l’algoritmo è completamente data-oblivious: non richiede retraining, fine-tuning o calibrazione. Lo applichi a qualsiasi modello transformer e funziona. Google l’ha testato su Gemma, Mistral e Llama-3.1-8B-Instruct con benchmark fino a 104.000 token — LongBench, NIAH, ZeroSCROLLS, RULER, L-Eval — e i risultati mostrano perdita di accuratezza sotto la soglia misurabile. La versione a 4 bit raggiunge speedup fino a 8x nel calcolo degli attention logits su GPU NVIDIA H100.